Page 26 - 128

P. 26

log e

2

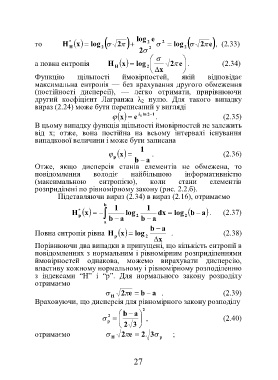

то H * logx 2 2 log 2 e , (2.33)

H 2 2 2

2

а повна ентропія H logx 2 e . (2.34)

H 2

x

Функцію щільності ймовірностей, якій відповідає

максимальна ентропія — без врахування другого обмеження

(постійності дисперсії), — легко отримати, прирівнюючи

другий коефіцієнт Лагранжа λ 2 нулю. Для такого випадку

вираз (2.24) може бути переписаний у вигляді

ex 1 ln 2 1 . (2.35)

В цьому випадку функція щільності ймовірностей не залежить

від х; отже, вона постійна на всьому інтервалі існування

випадкової величини і може бути записана

1

x . (2.36)

p

b a

Отже, якщо дисперсія станів елементів не обмежена, то

повідомлення володіє найбільшою інформативністю

(максимальною ентропією), коли стани елементів

розприділені по рівномірному закону (рис. 2.2.б).

Підставляючи вираз (2.34) в вираз (2.16), отримаємо

b 1 1

H * x log dx log b a . (2.37)

p b a 2 b a 2

a

b a

Повна ентропія рівна H logx . (2.38)

p 2

x

Порівнюючи два випадки в припущені, що кількість ентропії в

повідомленнях з нормальним і рівномірним розприділеннями

ймовірностей однакова, можемо вирахувати дисперсію,

властиву кожному нормальному і рівномірному розподіленню

з індексами “Н” і “р”. Для нормального закону розподілу

отримаємо

2 e b a . (2.39)

H

Враховуючи, що дисперсія для рівномірного закону розподілу

2

b a

2

, (2.40)

p

2 3

отримаємо 2 e 2 3 ;

H p

27