Page 70 - 4703

P. 70

того, як навчання мережі завершене, ви можете перевірити

якість її роботи на окремій тестовій множині.

У пакеті STATISTICA Neural Networks реалізований та-

кож цілий ряд алгоритмів навчання для мереж іншої архітек-

тури. Параметри радіальних елементів і коефіцієнти згладжу-

вання у мережі на радіальних базисних функціях і узагальне-

но-регресійній мережі можуть вибиратися методами навчання

Кохонена, підвибірки, K-средних, найближчих сусідів або ізо-

тропно. Нейрони лінійного вихідного шару у радіальної бази-

сної функції і у лінійних мережах повністю оптимізуються

методом сингулярного розкладання (SVD).

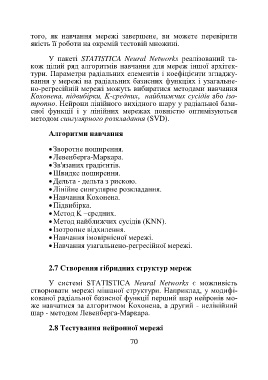

Алгоритми навчання

Зворотне поширення.

Левенберга-Маркара.

Зв'язаних градієнтів.

Швидке поширення.

Дельта - дельта з рискою.

Лінійне сингулярне розкладання.

Навчання Кохонена.

Підвибірка.

Метод K –средних.

Метод найближчих сусідів (KNN).

Ізотропне відхилення.

Навчання імовірнісної мережі.

Навчання узагальнено-регресійної мережі.

2.7 Створення гібридних структур мереж

У системі STATISTICA Neural Networks є можливість

створювати мережі мішаної структури. Наприклад, у модифі-

кованої радіальної базисної функції перший шар нейронів мо-

же навчатися за алгоритмом Кохонена, а другий - нелінійний

шар - методом Левенберга-Маркара.

2.8 Тестування нейронної мережі

70