Page 69 - 4703

P. 69

Для навчання багатошарових персептронів тут реалізо-

ваний, передусім, метод зворотного поширення помилки з ти-

ми, що міняються в часі швидкістю навчання і коефіцієнтом

інерції, перемішуванням спостережень перед черговим кроком

алгоритму і додаванням аддитивного шуму для робастного

узагальнення.

Окрім цього, в системі STATISTICA Neural Networks реа-

лізовано два швидкі алгоритми другого порядку - методи зв'я-

заних градієнтів і Левенберга-Маркара. Останній з них є над-

звичайно потужний сучасний метод нелінійної оптимізації. В

той же час, сфера застосування цього методу обмежена випад-

ками відносно невеликих за розміром мереж з одним вихідним

нейроном, а для громіздкіших завдань в пакеті STATISTICA

Neural Networks застосовується метод зв'язаних градієнтів. Як

правило, і той і інший алгоритм збігаються швидше, ніж метод

зворотного поширення, і при цьому, зазвичай, видають більш

відповідне рішення.

Ітеративний процес навчання мережі в системі

STATISTICA Neural Networks супроводжується автоматичним

показом поточної помилки навчання і обчислюваною незале-

жно від неї помилкою на контрольній множині, при цьому

можна вивести як графік сумарної помилки, так і гістограми

помилок для окремих спостережень. Ви можете перервати

навчання у будь-який момент, просто натиснувши кнопку

Stop.

У системі є можливість задати умови зупинки, при вико-

нанні яких навчання слід перервати; такою умовою може бути,

наприклад, досягнення певного рівня помилки або стабільне

зростання контрольної помилки упродовж заданого числа

проходів - "епох" (що свідчить про так зване перенавчання

мережі).

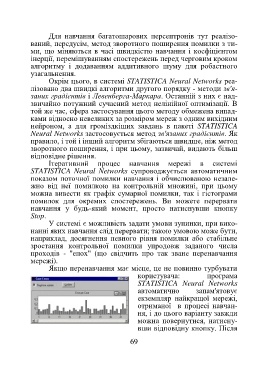

Якщо перенавчання має місце, це не повинно турбувати

користувача: програма

STATISTICA Neural Networks

автоматично запам'ятовує

екземпляр найкращої мережі,

отриманої в процесі навчан-

ня, і до цього варіанту завжди

можна повернутися, натисну-

вши відповідну кнопку. Після

69