Page 29 - 4848

P. 29

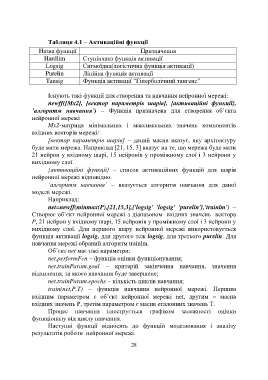

Таблиця 4.1 – Активаційні функції

Назва функції Призначення

Hardlim Ступінчата функція активації

Logsig Сигмоїдна(логістична функція активації)

Purelin Лінійна функція активації

Tansig Функція активації ”Гіперболічний тангенс”

Існують такі функції для створення та навчання нейронної мережі:

newff([Mx2], [вектор параметрів шарів], {активаційні функції},

’алгоритм навчання’) Функція призначена для створення об’єкта

нейронної мережі

Mx2-матриця мінімальних і максимальних значень компонентів

вхідних векторів мережі/

[вектор параметрів шарів] даний масив вказує, яку архітектуру

буде мати мережа. Наприклад [21, 15, 3] вказує на те, що мережа буде мати

21 нейрон у вхідному шарі, 15 нейронів у проміжному слої і 3 нейрони у

вихідному слої.

{активаційні функції} список активаційних функцій для шарів

нейронної мережі відповідно.

‘алгоритм навчання’ вказується алгоритм навчання для даної

моделі мережі.

Наприклад:

net=newff(minmax(P),[21,15,3],{'logsig' 'logsig' 'purelin'},'trainlm')

Створює об’єкт нейронної мережі з діапазоном вхідних значень вектора

P, 21 нейрон у вхідному шарі, 15 нейронів у проміжному слої і 3 нейрони у

вихідному слої. Для першого шару нейронної мережі використовується

функція активації logsig, для другого теж logsig, для третього purelin. Для

навчання мережі обраний алгоритм trainlm.

Об’єкт net має такі параметри:

net.performFcn функція оцінки функціонування;

net.trainParam.goal критерій закінчення навчання, значення

відхилення, за якого навчання буде завершене;

net.trainParam.epochs кількість циклів навчання;

train(net,P,T) функція навчання нейронної мережі. Першим

вхідним параметром є об’єкт нейронної мережі net, другим масив

вхідних значень P, третім параметром є масив еталонних значень T.

Процес навчання ілюструється графіком залежності оцінки

функціоналу від циклу навчання.

Наступні функції відносять до функцій моделювання і аналізу

результатів роботи нейронної мережі.

28