Page 22 - 6865

P. 22

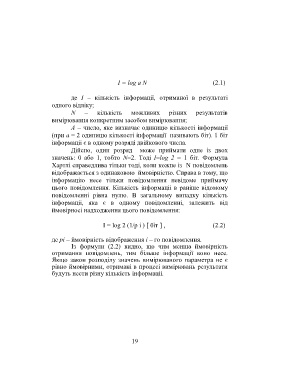

I = log а N (2.1)

де I – кількість інформації, отриманої в результаті

одного відліку;

N – кількість можливих різних результатів

вимірювання конкретним засобом вимірювання;

А – число, яке визначає одиницю кількості інформації

(при а = 2 одиницю кількості інформації називають біт). 1 біт

інформаціі є в одному розряді двійкового числа.

Дійсно, один розряд може приймати одне із двох

значень: 0 або 1, тобто N=2. Тоді I=log 2 = 1 біт. Формула

Хартлі справедлива тільки тоді, коли кожне із N повідомлень

відображається з одинаковою ймовірністю. Справа в тому, що

інформацію несе тільки повідомлення невідоме приймачу

цього повідомлення. Кількість інформаціі в раніше відомому

повідомленні рівна нулю. В загальному випадку кількість

інформаціі, яка є в одному повідомленні, залежить від

ймовірносі надходження цього повідомлення:

I = log 2 (1/p i ) [ біт ] , (2.2)

де pi – ймовірність відображення і – го повідомлення.

Із формули (2.2) видно, що чим менша ймовірність

отримання повідомлень, тим більше інформації воно несе.

Якщо закон розподілу значень вимірюваного параметра не є

рівно ймовірними, отримані в процесі вимірювань результати

будуть нести різну кількість інформаціі.

19